好的,这是一篇关于 stable-diffusion.cpp 项目的技术介绍文章,并附有基础使用实例。

标题: 轻量、高效、无依赖:深入解读 stable-diffusion.cpp 项目

副标题: 在纯 C++ 环境中运行 Stable Diffusion 图像生成

引言: 当 AI 绘画遇见 C++ 的高效世界

Stable Diffusion 作为当前最热门的文本生成图像模型,其官方实现和主流应用(如 WebUI)通常基于 Python 和 PyTorch 生态。这带来了强大的灵活性和丰富的功能,但也伴随着沉重的环境依赖、较大的内存占用和相对复杂的部署流程。

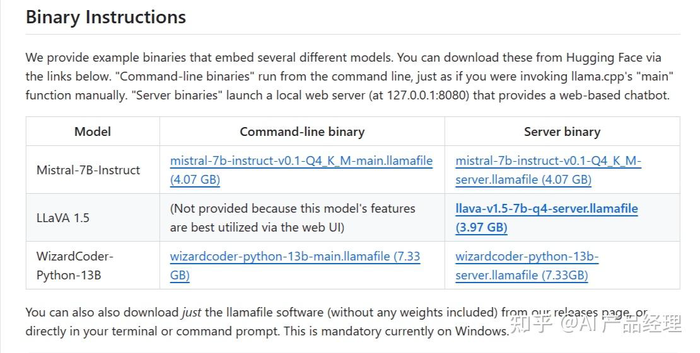

在此背景下,stable-diffusion.cpp 项目应运而生。这是一个由开发者 leejet 创建的开源项目,其核心目标是将 Stable Diffusion 模型完全移植到纯 C/C++ 环境中运行。它不依赖于 Python、PyTorch 或 CUDA,仅通过 ggml 库(一个为机器学习设计的张量库)和 stb 等轻量级库,实现了在 CPU(或通过 CLBlast 支持的部分 GPU)上高效地进行推理。这为追求极致轻量化、可移植性和部署简便性的场景提供了全新的选择。

一、 项目核心特点与优势

极致的轻量与无依赖:

- 核心依赖仅为

ggml:项目构建于ggml之上,这是一个用 C 语言编写、专注于推理的机器学习张量库,以高效和零依赖著称。 - 无 Python/PyTorch:彻底摆脱了 Python 环境配置、版本冲突、虚拟环境管理等繁琐问题。编译后得到一个独立的可执行文件,可以在任何支持的目标平台上运行。

- 支持多后端:

- CPU:默认且最稳定的模式,利用

ggml的 SIMD 指令优化,在现代 CPU 上速度可观。 - GPU(通过 OpenCL):集成

CLBlast支持,可以将计算任务卸载到兼容 OpenCL 的 GPU(包括许多集成显卡和 AMD GPU)上,显著提升速度。 - Apple Silicon:通过

ggml的 Metal 后端,可以在 Apple M1/M2/M3 芯片上获得原生 GPU 加速,体验流畅。

- CPU:默认且最稳定的模式,利用

- 核心依赖仅为

高效的模型格式:GGML 与量化

- 项目使用

ggml定义的二进制模型格式。原始 PyTorch 模型(.ckpt或.safetensors)需要先通过项目提供的转换脚本转换为ggml格式。 - 强力支持模型量化。量化是一种在几乎不损失生成质量的前提下,大幅减少模型体积和内存占用的技术。

stable-diffusion.cpp支持多种量化等级(如 Q4_0, Q4_1, Q5_0, Q5_1 等)。例如,原始的 FP16 模型约 2GB,而量化后的 Q4_0 模型可能仅需 700MB 左右,内存占用也相应减少,使得在资源受限的设备(如树莓派、老旧电脑)上运行成为可能。

- 项目使用

简洁的命令行接口 项目通过命令行参数进行控制,结构清晰,易于脚本化集成。用户只需指定模型路径、提示词、输出设置等即可生成图像。

活跃的开源社区 项目在 GitHub 上持续更新,积极跟进 Stable Diffusion 社区的新进展(如 SDXL 模型支持),并不断进行性能优化和功能添加。

二、 技术架构浅析

项目的核心流程遵循标准的 Stable Diffusion 推理管线,但全部由 C++ 实现:

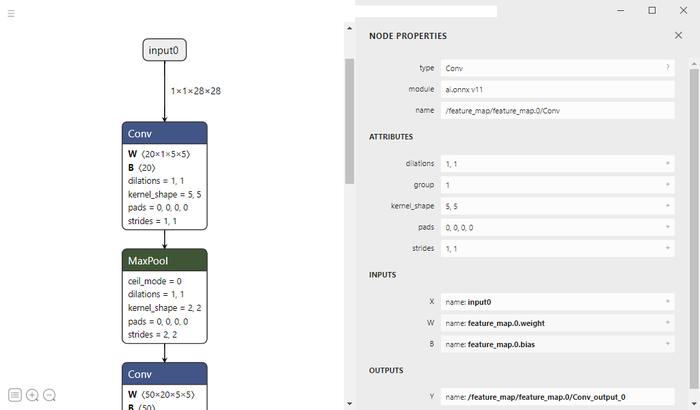

- 文本编码: 使用 CLIP 模型的文本编码器将输入的提示词(prompt)转换为文本嵌入向量。

- 扩散过程: 在潜空间(Latent Space)中,使用 UNet 模型对随机噪声进行多次迭代去噪。这是计算最密集的部分,也是

ggml和 GPU 加速发挥作用的重点。 - 图像解码: 使用 VAE 的解码器将去噪后的潜变量转换回最终的像素图像。

所有模型组件(CLIP, UNet, VAE)都被转换为 ggml 格式并加载到内存中,由统一的 ggml 计算图调度执行。

三、 实战:从零开始生成你的第一张 C++ AI 绘画

以下是一个在 Linux/macOS 系统上的基础使用示例。Windows 用户可通过 MSYS2 或 WSL 获得类似体验。

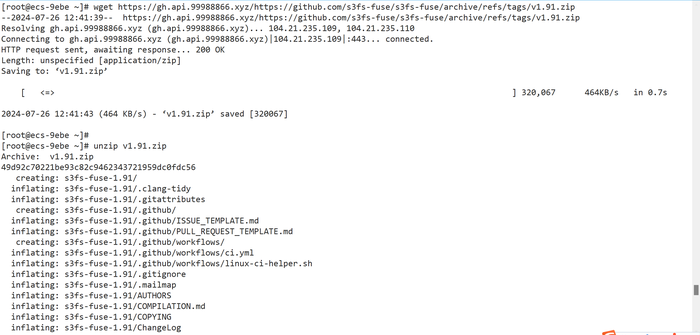

步骤 1: 获取项目与编译

# 克隆仓库 git clone https://github.com/leejet/stable-diffusion.cpp cd stable-diffusion.cpp # 编译项目(以启用 OpenCL 为例) mkdir build && cd build cmake .. -DGGML_OPENCL=ON # 启用 OpenCL 支持,如果只用 CPU 则去掉此参数 cmake --build . --config Release

编译完成后,在 build/bin/ 目录下会生成可执行文件 sd。

步骤 2: 准备模型

1. 获取原始 Stable Diffusion 1.5 模型(如 v1-5-pruned-emaonly.safetensors),并将其放入 models/ 目录。

2. 使用项目内的转换脚本,将其转换为 ggml 格式并量化:

# 回到项目根目录

cd ..

# 将模型转换为 FP16 格式的 ggml 模型

python3 convert.py --model-path models/v1-5-pruned-emaonly.safetensors --outtype f16

# 进一步量化,例如转换为 Q4_0 格式以节省空间

./quantize models/ggml-model-f16.gguf models/ggml-model-q4_0.gguf q4_0

最终你会得到一个小得多的模型文件 ggml-model-q4_0.gguf。

步骤 3: 运行生成

# 进入构建目录,使用量化后的模型生成图像 cd build ./bin/sd -m ../models/ggml-model-q4_0.gguf -p "A beautiful sunset over a serene lake, digital art" -n 1 -o output.png -s 42

-m: 指定模型路径。-p: 正向提示词。-n: 采样步数,影响生成质量和时间。-o: 输出文件名。-s: 随机种子,固定种子可以复现相同结果。

稍等片刻,你将在当前目录下获得 output.png,这就是由纯 C++ 程序生成的 AI 图像!

四、 适用场景与局限性

适用场景: * 嵌入式与边缘设备:在树莓派、Jetson Nano 等设备上部署轻量级 AI 绘画应用。 * 简易部署与集成:需要将 Stable Diffusion 作为功能模块集成到现有的 C++ 应用或服务中。 * 学习与研究:对于想深入了解 Stable Diffusion 模型底层推理机制和 C++ 高性能机器学习实现的开发者来说,是极佳的学习材料。 * 资源受限环境:在只有 CPU 或内存较小的机器上运行。

当前局限性: * 功能相对基础:相比 AUTOMATIC1111 的 WebUI,缺少丰富的插件、图生图、精细参数调整等高级功能。 * 性能:在高端 NVIDIA GPU 上,其性能通常仍不及经过深度优化的 PyTorch + CUDA + cuDNN 组合。 * 模型兼容性:主要支持 SD 1.5, 2.1 及 SDXL 基础架构,对一些社区微调模型(LoRA)的支持可能有限或需要额外转换步骤。

结语

stable-diffusion.cpp 项目是 AI 模型部署优化领域一个非常出色的实践。它证明了通过精巧的 C++ 实现和高效的底层库,即使像 Stable Diffusion 这样复杂的大模型,也能被驯服在轻量级、无依赖的环境中运行。它可能不是功能最全、速度最快的选择,但其在可移植性、简洁性和部署便利性上树立了新的标杆,为 AI 技术的普及和应用落地开辟了另一条切实可行的道路。

对于开发者而言,无论是为了在特定场景中实际应用,还是为了学习 AI 模型推理的底层奥秘,这个项目都值得深入探索和尝试。

还没有评论,来说两句吧...