llama.cpp:在C++中高效运行LLaMA大语言模型

项目概述

llama.cpp 是一个用纯C/C++编写的项目,旨在高效运行Meta的LLaMA大语言模型。该项目最大的特点是无需依赖Python或PyTorch,仅使用C/C++就能在CPU上高效推理LLaMA模型,大大降低了部署门槛和资源需求。

核心特性

1. 纯C/C++实现

- 完全用C/C++编写,无Python依赖

- 支持多种操作系统:Linux、macOS、Windows

- 使用GGML张量库进行高效计算

2. 量化支持

- 支持多种量化格式(4位、5位、8位等)

- 显著减少内存占用,提升推理速度

- 支持混合精度推理

3. 硬件优化

- 针对AVX2、AVX-512等指令集优化

- 支持ARM NEON指令集

- 支持Apple Silicon芯片(M1/M2等)

4. 轻量级部署

- 模型文件小,内存占用低

- 适合资源受限环境

- 易于集成到其他C++项目中

快速开始示例

1. 克隆与编译

text

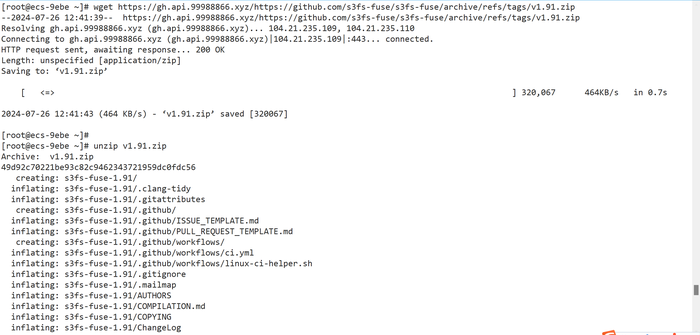

# 克隆项目 git clone https://github.com/ggml-org/llama.cpp cd llama.cpp # 编译(Linux/macOS) make # 或者使用CMake mkdir build && cd build cmake .. && cmake --build .

2. 模型转换

首先需要将原始LLaMA模型转换为GGML格式:

text

# 转换模型为GGML格式(需要Python环境) python convert.py /path/to/llama/model # 量化模型(例如转换为4位量化) ./quantize /path/to/ggml-model-f16.bin /path/to/ggml-model-q4_0.bin q4_0

3. 基本使用示例

text

// 简单的C++调用示例

#include "llama.h"

int main() {

// 初始化模型参数

llama_model_params model_params = llama_model_default_params();

llama_context_params ctx_params = llama_context_default_params();

// 加载模型

llama_model *model = llama_load_model_from_file("models/7B/ggml-model-q4_0.bin", model_params);

llama_context *ctx = llama_new_context_with_model(model, ctx_params);

// 准备输入

std::string prompt = "Once upon a time";

std::vector<llama_token> tokens = llama_tokenize(ctx, prompt, true);

// 推理

llama_decode(ctx, llama_batch_get_one(tokens.data(), tokens.size(), 0, 0));

// 生成文本

for (int i = 0; i < 100; i++) {

llama_token new_token = llama_sample_token(ctx, NULL);

if (new_token == llama_token_eos(ctx)) break;

std::string piece = llama_token_to_piece(ctx, new_token);

std::cout << piece << std::flush;

tokens.push_back(new_token);

llama_decode(ctx, llama_batch_get_one(&new_token, 1, tokens.size() - 1, 0));

}

// 清理资源

llama_free(ctx);

llama_free_model(model);

return 0;

}

4. 命令行使用

text

# 交互式对话模式 ./main -m models/7B/ggml-model-q4_0.bin -n 256 --interactive # 批量处理文本 ./main -m models/7B/ggml-model-q4_0.bin -p "The future of AI is" -n 100 # 指定温度参数 ./main -m models/7B/ggml-model-q4_0.bin -p "Explain quantum computing" -t 0.8 -n 200

高级功能

1. 流式输出

text

// 设置流式回调

llama_context_params params = llama_context_default_params();

params.progress_callback = [](float progress, void *ctx) {

std::cout << "进度: " << progress * 100 << "%" << std::endl;

return true;

};

2. 自定义采样

text

// 自定义采样参数

llama_sampling_params sparams = {};

sparams.temp = 0.8f;

sparams.top_k = 40;

sparams.top_p = 0.95f;

// 应用采样策略

llama_token sampled = llama_sample_token(ctx, &sparams);

3. 批处理推理

text

// 创建批处理

llama_batch batch = llama_batch_init(512, 0, 1);

// 添加多个序列

for (size_t i = 0; i < sequences.size(); i++) {

batch.token[i] = sequences[i].token;

batch.pos[i] = sequences[i].pos;

batch.seq_id[i] = sequences[i].id;

batch.logits[i] = sequences[i].logits;

}

batch.n_tokens = sequences.size();

// 执行批处理推理

llama_decode(ctx, batch);

性能优化技巧

1. 选择合适的量化级别

text

# 不同量化级别的比较 q4_0: 速度快,质量较好(推荐) q4_1: 质量更好,速度稍慢 q5_0/q5_1: 质量更高,内存占用稍多 q8_0: 接近原始精度,内存占用大

2. 调整上下文大小

text

// 根据需求调整上下文大小 ctx_params.n_ctx = 2048; // 默认值 ctx_params.n_ctx = 4096; // 处理长文本 ctx_params.n_ctx = 512; // 节省内存

3. 使用指令集优化

text

# 编译时启用特定优化 make LLAMA_AVX2=1 # AVX2指令集 make LLAMA_AVX512=1 # AVX-512指令集 make LLAMA_F16C=1 # F16C指令集

实际应用场景

1. 嵌入式设备部署

由于llama.cpp的低资源需求,它非常适合在以下场景部署: - 边缘计算设备 - 移动设备 - 资源受限的服务器

2. 与其他系统集成

text

// 示例:将llama.cpp集成到Web服务器中

class LLMService {

private:

llama_model *model;

llama_context *ctx;

public:

LLMService(const std::string& model_path) {

model = llama_load_model_from_file(model_path.c_str(),

llama_model_default_params());

ctx = llama_new_context_with_model(model,

llama_context_default_params());

}

std::string generate(const std::string& prompt) {

// 生成逻辑

return generated_text;

}

};

3. 批量处理服务

text

# 使用llama.cpp构建批处理服务 ./server -m model.bin -c 2048 -t 8 --port 8080

注意事项

- 模型格式:需要先将原始LLaMA模型转换为GGML格式

- 内存需求:7B模型约需4-8GB RAM,具体取决于量化级别

- 性能调优:根据硬件选择合适的编译选项和量化级别

- 许可证:注意遵守LLaMA模型的使用许可

总结

llama.cpp 为在C++环境中部署和运行大语言模型提供了一个高效、轻量级的解决方案。它的纯C/C++实现、优秀的量化支持和跨平台特性,使其成为在资源受限环境中部署LLM的理想选择。无论是用于研究、产品开发还是边缘计算,llama.cpp都展示了C++在现代AI应用中的强大能力。

通过合理的量化策略和优化配置,开发者可以在保持较好生成质量的同时,显著降低硬件要求,让大语言模型能够在更广泛的设备上运行。

llama.cpp_20260205150243.zip

类型:压缩文件|已下载:1|下载方式:免费下载

立即下载

还没有评论,来说两句吧...