背景与意义

在现代人工智能部署领域,边缘计算正逐渐成为主流趋势。随着物联网设备性能的不断提升,越来越多的推理任务需要从云端下沉到终端设备。ONNX(Open Neural Network Exchange)作为一种开放的模型格式,极大地促进了不同深度学习框架之间的互操作性。然而,在资源受限的边缘设备上,如何高效地加载并流式处理 ONNX 模型,仍然是一个技术挑战。C++ 凭借其高性能和底层控制能力,成为了实现这一目标的首选语言。OnnxStream 项目正是在这样的背景下应运而生,旨在为开发者提供一套简洁、高效且易于集成的 C++ 流式推理解决方案。

该项目不仅仅是一个简单的模型加载器,更是一个专注于数据流处理的推理引擎封装。它解决了传统批量推理在高实时性场景下的延迟问题,通过流式接口允许数据分片进入模型,从而显著降低了首帧延迟和内存占用。对于音频处理、传感器数据分析以及实时视频流理解等应用场景,这种流式处理能力至关重要。

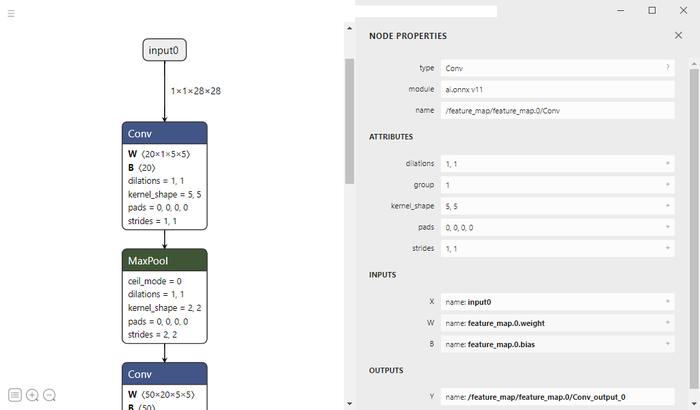

项目核心架构

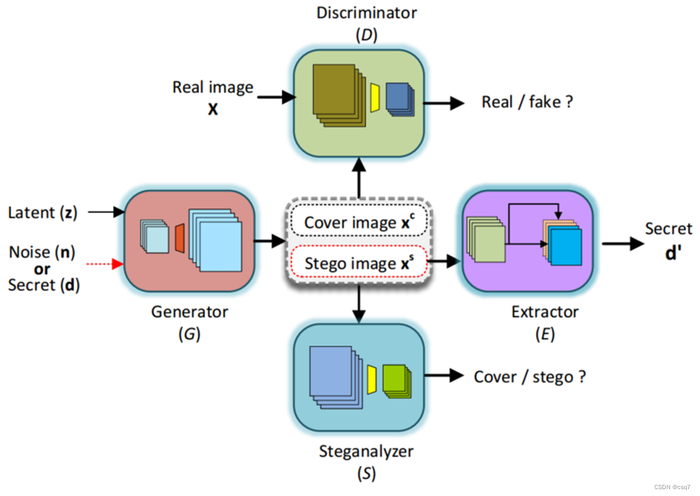

OnnxStream 的设计哲学围绕着“低耦合”与“高吞吐”展开。其核心架构通常包含模型管理模块、会话管理模块以及数据流缓冲模块。模型管理模块负责解析 ONNX 文件,验证输入输出节点的维度与类型,确保模型与运行时环境的兼容性。会话管理模块则基于 ONNX Runtime 进行封装,维护推理会话的生命周期,处理线程安全以及资源释放。

数据流缓冲模块是该项目区别于普通推理库的关键所在。它实现了一个环形缓冲区或队列机制,允许生产者线程不断写入传感器数据,而消费者线程则从缓冲区读取数据块进行推理。这种解耦设计使得数据采集与模型推理可以并行执行,充分利用多核 CPU 的计算能力。此外,项目内部通常集成了内存池技术,避免在高频推理过程中频繁申请和释放内存,从而减少系统抖动,保证推理延迟的稳定性。

环境构建与依赖

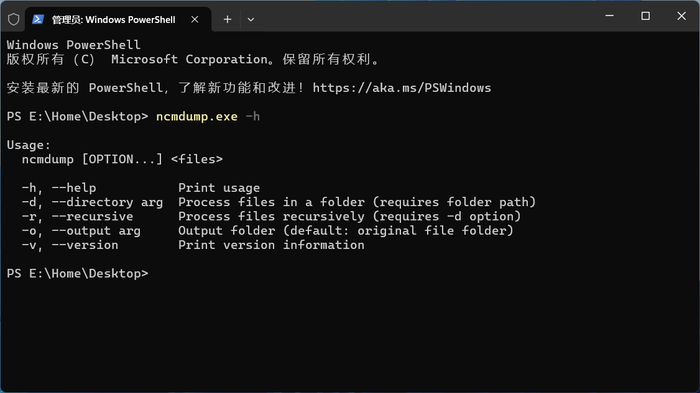

要在本地开发环境中集成 OnnxStream,首先需要确保系统安装了基础的 C++ 编译工具链,如 GCC 或 Clang,以及 CMake 构建系统。项目通常依赖 ONNX Runtime 作为底层推理引擎,因此需要预先编译或安装对应平台的 ONNX Runtime 库。在 Linux 环境下,可以通过包管理器安装依赖,或者从源码编译以获得最佳性能优化。

构建过程一般遵循标准的 CMake 工作流。开发者克隆仓库后,在项目根目录创建构建文件夹,执行配置命令指定安装路径和编译选项。例如,可以开启 AVX 指令集支持以加速矩阵运算,或启用 CUDA 支持以利用 GPU 进行加速。编译完成后,生成的静态库或动态链接库可以直接链接到用户的应用程序中。头文件提供了清晰的 API 接口,涵盖了初始化、数据输入、推理执行及结果获取等全流程功能。

实战代码示例

以下代码片段展示了如何在 C++ 项目中利用 OnnxStream 进行典型的流式推理。首先实例化流式处理器对象,加载预训练好的 ONNX 模型文件。初始化阶段会检查模型元数据,分配必要的内部缓冲区。

#include "OnnxStream.h"

#include <iostream>

#include <vector>

int main() {

// 初始化流式推理引擎

OnnxStream::Engine engine;

if (!engine.LoadModel("path/to/model.onnx")) {

std::cerr << "模型加载失败" << std::endl;

return -1;

}

// 配置流式参数

OnnxStream::Config config;

config.batch_size = 1;

config.sequence_length = 100;

engine.Configure(config);

// 模拟数据流输入

std::vector<float> input_data(100);

std::vector<float> output_data;

while (true) {

// 获取传感器数据

GetSensorData(input_data.data());

// 执行流式推理

if (engine.Infer(input_data, output_data)) {

ProcessResult(output_data);

} else {

std::cerr << "推理执行错误" << std::endl;

break;

}

}

return 0;

}

上述示例中,LoadModel 方法负责解析模型结构,Configure 允许用户根据实际业务需求调整批次大小和序列长度。Infer 接口是核心调用点,它接受输入数据向量并返回推理结果。这种同步调用方式适用于简单场景,而在复杂的多线程环境中,项目通常也提供异步回调接口,允许用户在推理完成后接收通知,从而避免阻塞主线程。

性能优化策略

在实际部署中,性能优化是不可或缺的一环。OnnxStream 支持多种优化手段以提升推理效率。首先是算子融合,底层引擎会自动识别可融合的算子序列,减少内核启动开销。其次是内存布局优化,通过调整数据在内存中的排列方式(如 NHWC 转 NCHW),提高 CPU 缓存命中率。

对于量化支持,项目允许加载 INT8 量化模型,这在几乎不损失精度的前提下,能将模型体积压缩至原来的四分之一,并显著提升推理速度。多线程并行也是关键策略,通过设置内部线程池大小,可以匹配硬件的核心数,最大化 CPU 利用率。此外,开发者还可以利用绑定 CPU 亲和性,将推理线程固定在特定核心上,减少上下文切换带来的性能损耗。

总结

C++ OnnxStream 项目为边缘 AI 部署提供了一套强有力的工具集。它通过抽象复杂的底层细节,让开发者能够专注于业务逻辑的实现。无论是构建智能语音助手、工业缺陷检测系统,还是自动驾驶感知模块,该项目都能提供稳定的流式推理支持。随着开源社区的不断贡献,其功能生态将更加丰富,成为连接算法模型与终端应用的重要桥梁。深入理解并掌握此类工具,对于从事高性能 AI 工程化的技术人员而言,具有重要的实践价值。

还没有评论,来说两句吧...