揭秘强化学习的“练兵场”:C++ Arcade-Learning-Environment (ALE) 深度解析与实战指南

1. 项目概述

Arcade-Learning-Environment (ALE) 是一个为强化学习(Reinforcement Learning, RL)研究而设计的开源平台。它将经典的 Atari 2600 游戏机模拟器转化为一个标准的机器学习环境,使得 AI 代理(Agent)可以通过观察游戏画面并采取行动,在不断的试错中学习如何获得最高分。

在深度强化学习的历史上,ALE 具有里程碑意义。著名的 DeepMind DQN 算法正是基于 ALE 环境,首次证明了深度神经网络可以直接从原始像素输入中学习复杂的控制策略,从而在多个 Atari 游戏中达到了人类水平甚至超越了人类。

目前,该项目由 Farama Foundation 维护,旨在提供一个高性能、稳定且易于集成的 C++ 核心库,并为 Python 等高级语言提供接口。

2. 核心架构与技术特点

2.1 C++ 核心驱动

ALE 的核心完全由 C++ 编写,这保证了模拟器在运行时的极高效率。由于强化学习需要数百万次甚至数亿次的采样(Step),任何微小的延迟在累积后都会导致训练时间增加数天。C++ 的高性能确保了环境能够以远超实时速度运行。

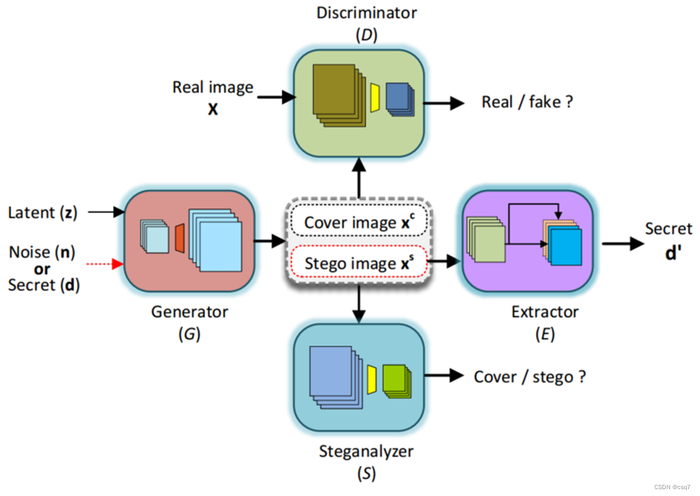

2.2 接口标准化

ALE 遵循了类似 OpenAI Gym 的接口规范,其核心交互循环为:

Observation (状态) $\rightarrow$ Action (动作) $\rightarrow$ Reward (奖励) $\rightarrow$ Next Observation (下一状态)。

2.3 随机性控制

为了保证科学实验的可重复性,ALE 提供了严格的种子(Seed)控制机制。无论是随机数生成器还是游戏内部的随机事件,都可以通过设定种子来完全复现。

2.4 预处理能力

ALE 支持多种图像预处理方案,例如: - 灰度化:将 RGB 图像转换为单通道灰度图,减少计算量。 - 下采样(Downsampling):将 \(210 \times 160\) 的分辨率降低至 \(84 \times 84\)。 - 帧堆叠(Frame Stacking):将连续的 4 帧图像堆叠在一起,使 AI 能够感知物体的运动方向和速度。

3. 快速开始:安装与配置

3.1 安装

最简单的方式是通过 Python 的 pip 安装(它会自动包含 C++ 编译后的二进制文件):

pip install ale-py

如果你需要从源码编译 C++ 核心(例如为了在非 Python 环境下使用),可以通过 CMake 进行构建:

git clone https://github.com/Farama-Foundation/Arcade-Learning-Environment.git cd Arcade-Learning-Environment mkdir build && cd build cmake .. make

3.2 游戏 ROMs 导入

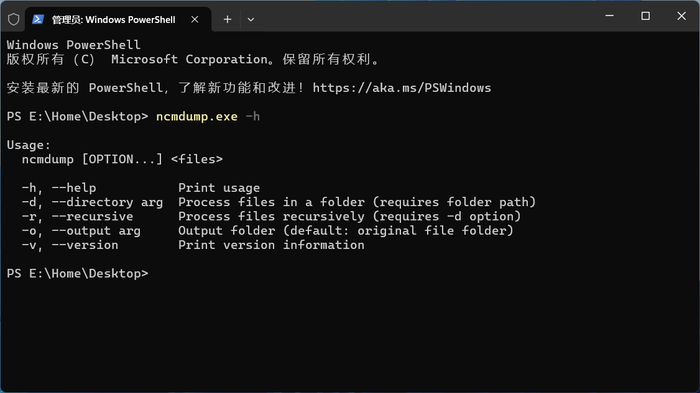

由于版权原因,ALE 不自带 Atari 游戏 ROM。你需要自行提供 .bin 文件。

可以使用 ale-py 提供的工具导入 ROM:

# 假设你已经有了 roms 文件夹 ale-import-roms /path/to/your/roms/

4. 实例演示:用 Python 调用 ALE

以下是一个基础的实例,演示如何初始化一个 Atari 游戏(以 Breakout 砖块打破者为例),并随机采取行动。

import gym

from ale_py import ALE

from ale_py.ale_py_env import AtariEnv

# 1. 创建环境

# 注意:这里使用了 gym 的封装,它是目前最主流的调用方式

env = gym.make('ALE/Breakout-v5', render_mode='human')

# 2. 重置环境到初始状态

observation, info = env.reset()

done = False

total_reward = 0

frames = 0

while not done:

# 3. 随机选择一个动作 (Action Space)

# 在 Breakout 中,动作包括:NOOP, FIRE, RIGHT, LEFT 等

action = env.action_space.sample()

# 4. 执行动作并获取反馈

# observation: 当前画面 (RGB 数组)

# reward: 本步获得的得分

# terminated: 游戏是否结束

# truncated: 是否达到最大步数限制

observation, reward, terminated, truncated, info = env.step(action)

total_reward += reward

frames += 1

# 渲染画面

env.render()

done = terminated or truncated

print(f"游戏结束!总得分: {total_reward}, 总步数: {frames}")

env.close()

代码要点解析:

env.reset(): 每次训练开始前必须调用,将游戏状态重置。env.step(action): 这是 RL 的核心,将动作发送给 C++ 模拟器,模拟器计算后返回新的状态和奖励。action_space.sample(): 随机采样。在实际项目中,这里会被替换为神经网络(如 CNN)输出的预测值。

5. 进阶:如何将其用于深度强化学习?

如果你想构建一个真正的 AI 智能体,建议按照以下流程集成 ALE:

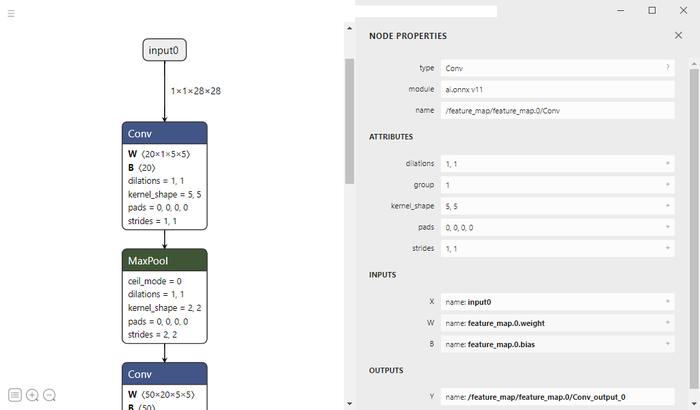

5.1 状态空间处理 (State Space)

直接使用 \(210 \times 160 \times 3\) 的图像输入会导致模型参数过多且训练缓慢。 推荐方案: - 将图像转换为灰度图 \(\rightarrow\) 缩放到 \(84 \times 84\) \(\rightarrow\) 归一化到 \([0, 1]\)。 - 使用 Frame Buffer:将最近 4 帧拼接,输入形状变为 \((84, 84, 4)\)。

5.2 奖励塑造 (Reward Shaping)

某些 Atari 游戏的奖励非常稀疏(例如只有在关卡结束时才给分)。为了加快收敛,研究者通常会对奖励进行处理: - 奖励裁剪 (Reward Clipping):将所有正奖励设为 \(+1\),负奖励设为 \(-1\),零奖励保持 \(0\)。这能增加训练的稳定性。

5.3 动作空间映射 (Action Mapping)

不同游戏的动作集不同。ALE 提供了统一的映射表,但你需要确保你的模型输出层维度与 env.action_space.n 一致。

6. 总结与评价

Arcade-Learning-Environment 不仅仅是一个模拟器,它是连接经典游戏逻辑与现代深度学习的桥梁。

- 对于初学者:它是学习强化学习(DQN, PPO, A3C)的最佳实践平台。

- 对于研究者:它提供了标准化的基准测试(Benchmark),让不同算法在同一环境下公平竞争。

- 对于开发者:其 C++ 核心保证了极高的扩展性和运行效率。

如果你对“让机器学会玩游戏”感兴趣,ALE 是你必须掌握的基石项目。通过在 Breakout、Space Invaders 或 Pong 等游戏中不断迭代,你将深刻理解智能体是如何在复杂环境下通过探索与利用(Exploration vs. Exploitation)来进化出强大能力的。

还没有评论,来说两句吧...