引言

在云计算与大数据飞速发展的今天,分布式存储系统作为基础设施的核心组件,其性能、可靠性与易用性直接决定了上层业务的质量。网易开源的 Curve 项目正是为此而生,它是一个高性能、云原生的分布式存储系统,旨在为云环境提供块存储与文件存储服务。该项目基于 C++ 开发,充分利用了现代硬件特性,如 RDMA 与 SPDK,以实现极致的 I/O 性能。本文将深入探讨 Curve 项目的架构设计、核心技术特性,并提供实际的部署与使用示例,帮助开发者快速掌握这一存储神器。

项目背景与定位

Curve 项目由网易内部孵化并开源,最初用于支撑网易云庞大的业务场景,包括云主机磁盘、容器持久化存储等。随着云原生技术的普及,传统存储系统在弹性伸缩、多租户隔离及运维复杂度方面面临挑战。Curve 应运而生,定位为云原生时代的存储解决方案。

项目分为两个主要子系统:CurveBS(块存储)与 CurveFS(文件存储)。CurveBS 提供类似 AWS EBS 的块设备服务,支持快照、克隆等功能;CurveFS 则提供 POSIX 兼容的文件系统接口,适用于高性能计算、AI 训练等场景。两者共享底层的分布式一致性协议与数据管理模块,确保了系统的一致性与高可用性。

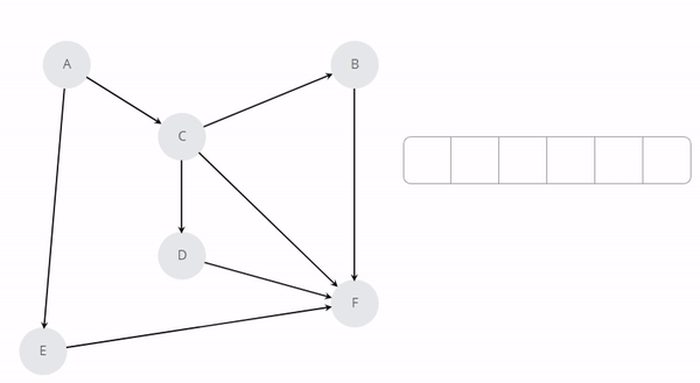

核心架构设计

Curve 的架构设计遵循分层解耦原则,主要由客户端(Client)、元数据服务器(MetaServer)与数据服务器(ChunkServer)组成。

1. 客户端层

客户端库以动态链接库形式提供,嵌入业务进程中。它负责将上层 I/O 请求转换为内部协议,并通过一致性哈希算法定位数据分片。客户端内置了缓存机制与重试逻辑,能够有效屏蔽后端节点的临时故障,提升读写 latency 的稳定性。在 C++ 实现上,客户端大量使用了 bthread 协程库,以高并发方式处理网络请求,避免了传统线程模型上下文切换的开销。

2. 元数据管理层

MetaServer 集群负责管理存储卷的元数据,包括分片分布、副本状态及快照信息。该层基于 braft 库实现 Raft 一致性协议,确保元数据操作强一致。当主节点发生故障时,集群会自动选举新主,保证服务不中断。元数据操作通常路径较短,因此对延迟极为敏感,Curve 对此进行了深度优化,包括内存索引结构与批量提交机制。

3. 数据存储层

ChunkServer 是实际存储数据的节点,负责管理物理磁盘上的数据块。它支持多副本与纠删码两种数据保护策略。多副本模式下,数据写入多个节点,读取速度快;纠删码模式下,空间利用率更高,适合冷数据存储。ChunkServer 同样基于 Raft 协议保证副本间数据一致,并支持在线扩容与 rebalance 操作。

关键技术特性

C++ 高性能实践

Curve 核心代码采用 C++11⁄14 标准编写,充分利用了现代 C++ 特性。例如,使用智能指针管理资源生命周期,避免内存泄漏;利用移动语义减少数据拷贝。在网络 IO 方面,项目集成了 bthread 与 brpc 框架,实现了高吞吐量的网络通信。此外,Curve 支持用户态网络栈,绕过内核协议栈,进一步降低 CPU 占用与延迟。

硬件加速支持

为了挖掘硬件潜力,Curve 集成了 RDMA(远程直接内存访问)与 SPDK(存储性能开发套件)。通过 RDMA,数据可以直接在内存之间传输,无需 CPU 参与,显著降低了网络延迟。SPDK 则允许用户态程序直接访问 NVMe SSD,避免了内核中断与上下文切换,极大提升了随机读写性能。这些特性使得 Curve 在高性能场景下表现卓越。

云原生集成

Curve 天然支持 Kubernetes 环境,提供了 CSI(容器存储接口)插件。用户可以在 K8s 中通过 PVC 动态申请 Curve 存储卷,实现容器数据的持久化。此外,Curve 支持多租户隔离,通过配额管理与 QoS 限制,防止单一租户占用过多资源,保障集群整体稳定性。

快速部署与实例

为了帮助开发者快速体验,Curve 提供了基于 Docker 与 Kubernetes 的部署方案。以下是一个基于 Docker Compose 的简易部署示例。

环境准备

确保主机已安装 Docker 与 Docker Compose,并关闭防火墙或开放相应端口。

部署步骤

首先,创建配置文件 curve.conf,定义集群参数。随后,编写 docker-compose.yml 文件,定义 MetaServer 与 ChunkServer 服务。

version: '3'

services:

etcd:

image: quay.io/coreos/etcd:v3.4.13

command: etcd --name etcd --data-dir /etcd-data --listen-client-urls http://0.0.0.0:2379 --advertise-client-urls http://etcd:2379 --listen-peer-urls http://0.0.0.0:2380 --initial-advertise-peer-urls http://etcd:2380 --initial-cluster etcd=http://etcd:2380 --initial-cluster-token tokendemo --initial-cluster-state new

ports:

- "2379:2379"

- "2380:2380"

curvebs:

image: opencurve/curvebs:latest

network_mode: "host"

privileged: true

volumes:

- /data/curve:/data

command: bash /script/run.sh

执行 docker-compose up -d 启动集群。启动完成后,可通过客户端工具创建存储卷。

客户端使用示例

在 C++ 项目中集成 Curve 客户端库后,可通过以下代码片段进行读写操作:

#include "curve/client.h"

int main() {

curve::Client client;

curve::ClientOptions options;

options.configPath = "/etc/curve/client.conf";

if (client.Init(options) != 0) {

std::cerr << "Client init failed" << std::endl;

return -1;

}

std::string volumeName = "volume1";

char buffer[4096];

memset(buffer, 'a', sizeof(buffer));

// 写操作

int writeLen = client.Write(volumeName, 0, buffer, sizeof(buffer));

if (writeLen != sizeof(buffer)) {

std::cerr << "Write failed" << std::endl;

}

// 读操作

char readBuffer[4096];

int readLen = client.Read(volumeName, 0, readBuffer, sizeof(readBuffer));

if (readLen != sizeof(readBuffer)) {

std::cerr << "Read failed" << std::endl;

}

client.UnInit();

return 0;

}

上述代码展示了初始化客户端、写入数据及读取数据的基本流程。实际生产环境中,还需处理错误重试与连接管理。

性能优化指南

在生产环境部署 Curve 时,合理的参数调优至关重要。

网络优化

建议启用巨帧(Jumbo Frames),将 MTU 设置为 9000,以减少网络包数量。若硬件支持,务必开启 RDMA 功能,并配置正确的 IB 网卡参数。

磁盘配置

对于 ChunkServer,建议使用 NVMe SSD 作为数据盘。通过 SPDK 绑定网卡与磁盘,可避免中断冲突。同时,调整文件系统挂载参数,如 noatime,减少元数据更新开销。

并发控制

客户端并发度需根据业务场景调整。过高并发可能导致后端压力过大,过低则无法充分利用带宽。可通过 QoS 配置限制单租户的最大 IOPS 与带宽,防止资源争抢。

社区与贡献

Curve 项目托管于 GitHub,拥有活跃的社区。开发者可以通过提交 Issue 报告问题,或通过 Pull Request 贡献代码。项目文档完善,涵盖了架构设计、开发指南及运维手册。参与开源贡献不仅能提升个人技术影响力,还能推动存储技术的发展。

总结

Curve 项目代表了云原生分布式存储的先进水平。其基于 C++ 的高性能实现、灵活的架构设计以及对硬件加速的支持,使其成为构建现代云基础设施的理想选择。通过本文的介绍与实例,相信开发者能够对 Curve 有更深入的理解,并在实际项目中加以应用。随着技术的迭代,Curve 将继续演进,为数据存储领域带来更多创新。

还没有评论,来说两句吧...