引言:存储速度的终极追求

在计算机体系结构中,存储层级一直是性能的关键瓶颈。从机械硬盘到固态硬盘,再到系统内存,每一次跃迁都带来了数量级的速度提升。然而,随着数据处理需求的爆炸式增长,即便是 DDR4 或 DDR5 内存,在某些极端高性能计算场景下也显得捉襟见肘。GPU 显存(VRAM)凭借 GDDR6X 等技术,拥有远超系统内存的带宽潜力。C++ 开源项目 vramfs 正是基于这一理念诞生,它试图将 GPU 显存映射为文件系统,为用户提供一种前所未有的高速临时存储方案。

vramfs 项目概述

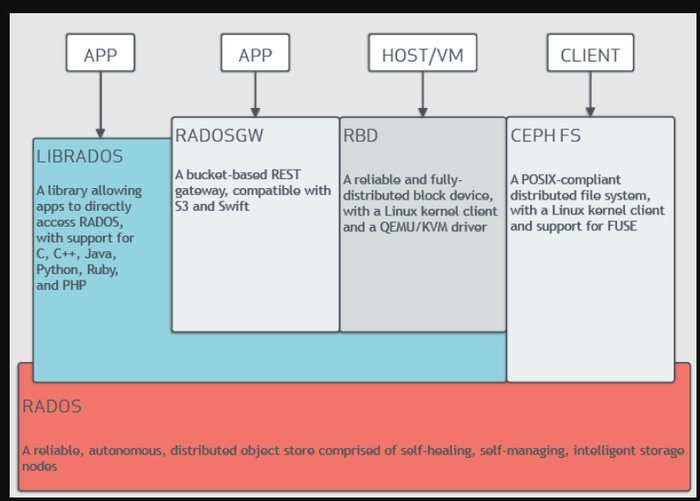

vramfs 是一个实验性的文件系统实现,其核心目标是将显卡显存作为存储介质,通过 FUSE(Filesystem in Userspace)技术在操作系统中挂载为一个标准的磁盘驱动器。该项目由开发者 Overv 发起,托管于 GitHub 平台。与传统基于 RAM 的 tmpfs 不同,vramfs 直接调用 CUDA API 分配显存,从而绕过系统内存控制器,直接利用 GPU 的高带宽通道进行数据读写。

这一设计并非为了替代传统硬盘进行持久化存储,而是专注于极致的临时数据吞吐。对于需要频繁读写大量临时文件的应用场景,如视频编码缓存、编译中间文件存储、大规模数据集 shuffle 等,vramfs 能够提供理论上的性能上限。

技术架构与实现原理

理解 vramfs 的工作原理,需要深入其软件架构的三个关键层面:

1. 显存分配机制

项目底层依赖 NVIDIA CUDA toolkit。通过 cudaMalloc 或更高级的内存管理 API,程序向 GPU 请求一块连续的显存空间。由于显存是易失性的,且通常不被 CPU 直接寻址,vramfs 需要建立一种映射机制。在现代 GPU 架构中,支持统一虚拟寻址(UVA),这使得 CPU 能够通过 PCIe 总线访问显存地址,尽管延迟较高,但带宽巨大。

2. FUSE 用户态文件系统

vramfs 利用 Linux 内核的 FUSE 模块,在用户空间实现文件系统逻辑。当用户态程序发起文件操作请求(如 open, read, write)时,内核将请求转发给 vramfs 守护进程。该进程负责解析路径、管理 inode 结构,并将数据块读写操作转化为对显存指针的内存拷贝。

3. 数据一致性管理

由于显存不具备硬盘的持久化特性,vramfs 需要在内存中维护文件元数据(文件名、大小、权限等)。项目内部实现了一个简化的文件分配表,记录哪些显存块被哪些文件占用。当文件系统卸载时,所有元数据及内容均会被清除,这符合其临时存储的定位。

编译与部署指南

由于 vramfs 涉及底层硬件交互,部署过程需要特定的开发环境。以下是在 Ubuntu 系统上的标准构建流程。

环境依赖

确保系统已安装以下组件: - C++ 编译器(GCC 或 Clang,支持 C++11 及以上标准) - CMake 构建系统 - NVIDIA CUDA Toolkit(版本需与显卡驱动匹配) - libfuse 开发库

构建步骤

首先克隆项目源代码:

git clone https://github.com/Overv/vramfs.git cd vramfs

创建构建目录并执行 CMake 配置:

mkdir build cd build cmake ..

若依赖检测通过,即可编译:

make -j$(nproc)

编译成功后,将在目录下生成可执行文件 vramfs。注意,运行该程序通常需要 root 权限,因为它需要挂载文件系统。

使用实例与操作命令

成功编译后,用户可以像操作普通磁盘一样使用 vramfs。以下是典型的操作流程。

挂载文件系统

假设需要分配 2GB 的显存空间,并挂载到 /mnt/vram 目录:

sudo mkdir -p /mnt/vram sudo ./vramfs /mnt/vram -o size=2048

参数 size 单位通常为 MB,具体需参考项目最新文档。挂载成功后,使用 df -h 命令即可看到一个新的挂载点,其大小等于指定的显存容量。

文件读写测试

可以使用 dd 命令进行简单的读写速度测试:

# 写入测试 dd if=/dev/zero of=/mnt/vram/testfile bs=1M count=1024 # 读取测试 dd if=/mnt/vram/testfile of=/dev/null bs=1M

在高端显卡上,写入速度可能突破 10GB/s,远超 NVMe SSD 的 7GB/s 上限。

卸载文件系统

使用完毕后,必须正确卸载以释放显存资源:

sudo umount /mnt/vram

若强制重启或未卸载,显存会被驱动程序回收,数据即刻丢失。

性能分析与对比

vramfs 的核心优势在于带宽。以下是典型硬件环境下的理论对比数据:

| 存储介质 | 典型带宽 | 延迟 | 持久性 |

|---|---|---|---|

| 机械硬盘 (HDD) | 150 MB/s | 高 | 持久 |

| 固态硬盘 (NVMe) | 3500 MB/s | 中 | 持久 |

| 系统内存 (tmpfs) | 20000 MB/s | 低 | 易失 |

| 显存 (vramfs) | 50000 MB/s+ | 中偏高 | 易失 |

值得注意的是,虽然显存带宽极高,但由于数据必须经过 PCIe 总线传输,CPU 与显存之间的通信延迟高于系统内存。因此,vramfs 更适合大块数据的顺序读写,而非大量小文件的随机访问。在视频流处理场景中,这种顺序高吞吐特性能够被最大化利用。

潜在风险与局限性

在使用 vramfs 之前,必须充分认知其风险,以免导致数据丢失或系统不稳定。

数据易失性

显存是典型的易失性存储器。一旦断电、系统崩溃、显卡驱动重置或计算机休眠,vramfs 中的所有数据将永久丢失。严禁将重要文档、数据库文件或不可再生的工作成果存储于此。

显存容量限制

GPU 显存通常比系统内存小得多。消费级显卡显存多在 8GB 至 24GB 之间,而系统内存可达 64GB 甚至更高。挂载过大的 vramfs 可能导致显存不足,进而影响图形界面渲染或 CUDA 计算任务的正常运行。

系统稳定性

作为一个实验性项目,vramfs 可能未经过严格的压力测试。在高负载下,可能会出现内核恐慌、驱动崩溃或文件系统锁死的情况。建议仅在测试环境或非关键任务中使用。

应用场景推荐

基于上述特性,vramfs 适合以下特定场景:

- 视频转码缓存:在使用 FFmpeg 等工具进行高码率视频处理时,将临时切片文件放入 vramfs,可显著减少 IO 等待时间。

- 大规模编译构建:对于 C++ 大型项目,编译过程中会产生大量中间对象文件。将构建目录指向 vramfs 可加速链接过程。

- 机器学习数据加载:在训练模型前,将数据集加载到 vramfs 中,可以加快 DataLoader 的读取速度,减少 GPU 空闲等待。

- 隐私数据临时处理:由于断电即焚的特性,适合处理敏感日志或临时密钥,无需后续进行安全擦除。

结语与展望

vramfs 展示了利用异构计算资源优化存储架构的可能性。虽然目前它仍是一个极客向的开源工具,存在容量小、易失性等限制,但其设计理念为未来的存储技术提供了新思路。随着 CXL 互联技术的发展和显存容量的不断攀升,未来或许会出现更稳定、容量更大的显存存储方案。对于追求极致性能的开发者而言,探索 vramfs 不仅是一次技术实践,更是对计算机体系结构边界的一次有趣挑战。在使用时,请务必做好数据备份,谨慎评估风险,让 GPU 的算力与存力共同服务于高效计算。

还没有评论,来说两句吧...