项目背景与概述

百度文件系统(Baidu File System,简称 BFS)是百度公司开源的一款高性能、高可靠的分布式文件系统。该项目托管于 GitHub 平台(https://github.com/baidu/bfs),主要由 C++ 语言编写,旨在解决大规模数据存储场景下的可靠性、可用性和扩展性问题。值得注意的是,虽然缩写为 BFS,但在此语境下它并非指代计算机算法中的“广度优先搜索”(Breadth-First Search),而是百度内部广泛使用的存储基础设施的开源版本。BFS 的设计灵感来源于 Google File System (GFS),针对百度自身的业务场景进行了深度优化,适用于日志存储、大数据计算中间存储、备份归档等多种场景。对于希望深入学习分布式系统架构、C++ 高性能编程以及存储引擎原理的开发者而言,BFS 是一个极具价值的研究样本。

核心架构设计

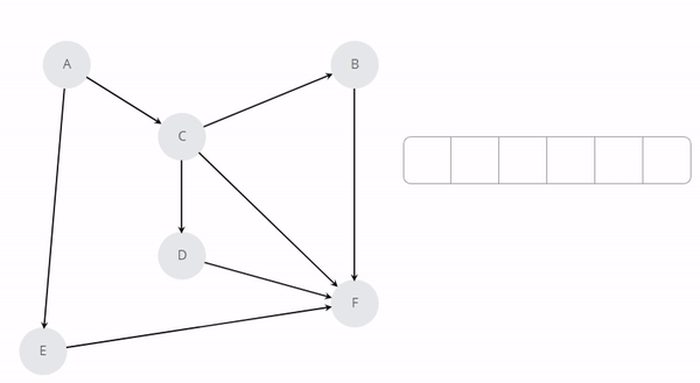

BFS 采用了经典的 Master-ChunkServer 主从架构,这种设计模式在分布式存储领域久经考验,能够有效地解耦元数据管理与实际数据存储。

1. Master 节点

Master 节点是整个集群的管理中枢,负责维护文件系统的命名空间、控制客户端对文件的访问权限以及管理 ChunkServer 的状态。Master 并不直接参与数据的读写传输,仅处理元数据操作,如文件创建、删除、重命名以及块位置查询。为了确保持久性,Master 会将元数据操作日志(OpLog)和检查点(Checkpoint)持久化到本地磁盘。在生产环境中,Master 通常配置为双机热备或基于 Paxos 协议的多副本模式,以防止单点故障导致整个集群不可用。

2. ChunkServer 节点

ChunkServer 是实际存储数据块的节点。文件被分割成固定大小的块(Chunk),默认大小通常为 64MB 或更大,以减少元数据压力。每个 Chunk 会在多个 ChunkServer 上存储副本,默认副本数通常为 3 份。ChunkServer 负责处理客户端的数据读写请求,并定期向 Master 汇报心跳和块列表。C++ 实现中,ChunkServer 高度优化了磁盘 IO 性能,利用异步 IO 和内存映射技术提升吞吐量。

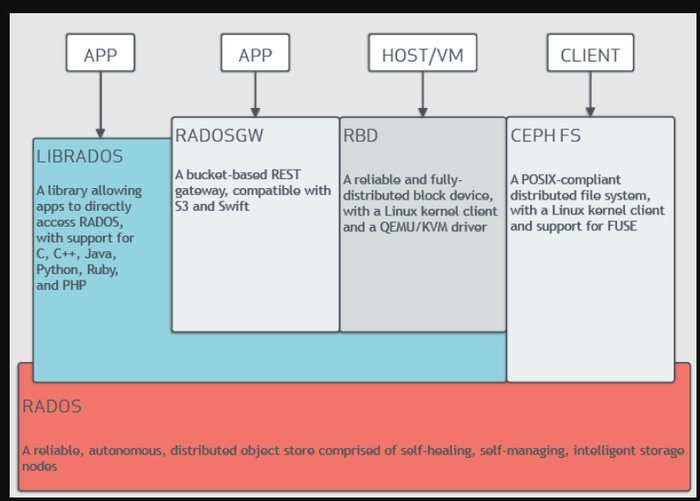

3. Client 端库

客户端库以动态链接库的形式提供给业务方使用。它屏蔽了底层的分布式复杂性,提供类似 POSIX 的文件操作接口。Client 缓存元数据信息,减少与 Master 的交互次数,从而降低延迟。在网络通信层面,BFS 深度集成了百度开源的高性能 RPC 框架 brpc,确保了节点间通信的高效与稳定。

关键技术栈与 C++ 实现细节

BFS 项目是 C++ 工程实践的典范,其中运用了多种现代 C++ 特性和开源组件。

1. 网络通信层

BFS 使用 brpc 作为主要的 RPC 框架。brpc 基于 Reactor 模式,支持高并发连接处理。在 C++ 代码中,可以看到大量的 ProtoBuf 定义用于序列化请求和响应消息。这种二进制序列化协议相比 JSON 或 XML 具有更高的解析效率和更小的网络传输开销。开发者在阅读源码时,可以重点关注 src/rpc 目录下的实现,学习如何定义服务接口以及处理回调函数。

2. 存储引擎层

底层存储依赖于 LevelDB,这是一个由 Google 开源的键值存储库。BFS 利用 LevelDB 来管理 Chunk 的元数据索引以及部分持久化日志。LevelDB 的 LSM-Tree 结构非常适合写多读少的场景,能够充分利用顺序写磁盘的性能。在 C++ 实现中,BFS 对 LevelDB 进行了封装,增加了快照管理和一致性校验功能。

3. 并发与内存管理

项目中广泛使用了 C++11 标准中的智能指针(如 std::shared_ptr 和 std::unique_ptr)来管理资源生命周期,避免内存泄漏。多线程并发控制通过 pthread 或 std::thread 结合互斥锁(std::mutex)和条件变量实现。特别是在 Master 节点处理大量元数据请求时,采用了读写锁机制来优化读性能,确保在高并发读取场景下系统不会成为瓶颈。

编译与部署指南

要在本地或测试环境中运行 BFS,需要满足一定的依赖环境。以下是基于 Linux 环境的编译步骤简述。

1. 依赖安装

BFS 依赖以下主要组件: - CMake (版本 3.10+) - Protobuf (版本 2.5 或 3.x) - LevelDB - brpc - gflags, glog, google-perftools

可以通过包管理器安装大部分依赖,例如在 Ubuntu 上使用 apt-get install libprotobuf-dev libleveldb-dev 等命令。brpc 可能需要从源码编译安装以确保版本兼容性。

2. 编译过程

项目采用 CMake 构建系统。克隆代码后,执行以下命令:

mkdir build && cd build cmake .. -DCMAKE_BUILD_TYPE=Release make -j4

编译完成后,可在 build 目录下找到 bfs_master、bfs_chunkserver 和 bfs_client 等可执行文件。

3. 集群配置

部署需要修改配置文件 conf/bfs.conf。主要配置项包括 Master 地址、ChunkServer 数据目录路径、副本数量策略以及网络端口号。初次启动时,应先启动 Master 节点,待其监听端口就绪后,再批量启动 ChunkServer 节点。客户端工具 bfs_client 可用于验证集群状态,例如执行 ls / 查看根目录文件列表。

代码实例与 API 使用

对于开发者而言,理解如何通过 C++ 代码与 BFS 交互至关重要。以下是一个简化的客户端写入示例,展示了如何初始化文件系统并写入数据。

#include "client/file_system.h"

#include "client/file.h"

#include <iostream>

#include <string>

int main() {

// 初始化文件系统实例,指向 Master 地址

baidu::bfs::FileSystem* fs;

std::string master_addr = "127.0.0.1:8827";

if (!baidu::bfs::FileSystem::OpenFileSystem(master_addr.c_str(), &fs)) {

std::cerr << "Failed to open file system" << std::endl;

return -1;

}

// 创建文件

baidu::bfs::File* file = nullptr;

int32_t flags = O_WRONLY | O_CREAT;

if (!fs->OpenFile("/test/demo.txt", flags, &file)) {

std::cerr << "Failed to open file" << std::endl;

delete fs;

return -1;

}

// 写入数据

std::string data = "Hello, Baidu BFS!";

int32_t write_len = file->Write(data.c_str(), data.length());

if (write_len != static_cast<int32_t>(data.length())) {

std::cerr << "Write failed" << std::endl;

}

// 关闭文件并释放资源

file->Close();

delete file;

delete fs;

return 0;

}

上述代码展示了 BFS 客户端库的基本用法。在实际生产代码中,还需要处理重试逻辑、超时控制以及更复杂的错误码判断。BFS 的 C++ SDK 提供了丰富的接口,包括追加写、随机读、文件锁等操作,能够满足大多数大数据组件的存储需求。

性能优化与生产实践

在生产环境中部署 BFS,需要根据硬件配置进行细致的调优。磁盘 IO 往往是瓶颈所在,建议使用 RAID 卡或 SSD 来提升 ChunkServer 的读写性能。网络方面,确保节点间处于千兆或万兆局域网内,以减少数据复制带来的网络延迟。

此外,监控是运维的关键。BFS 提供了内置的监控接口,可以对接 Prometheus 或百度内部的监控平台。重点监控指标包括 Master 的内存使用率、ChunkServer 的磁盘剩余空间、网络吞吐量以及请求延迟分布。当集群规模扩大至数百节点时,元数据管理压力会显著增加,此时可以考虑调整块大小或优化 Master 的内存结构。

总结与展望

百度 BFS 项目不仅是一个可用的分布式存储系统,更是一个学习 C++ 大型项目架构的宝库。通过阅读其源码,开发者可以深入理解分布式一致性协议、高并发网络模型以及存储引擎内部机制。尽管当前对象存储和云原生存储方案日益流行,但理解 BFS 这类经典分布式文件系统的设计思想,对于构建任何大规模后端系统都具有不可替代的指导意义。社区欢迎开发者提交 Issue 和 Pull Request,共同推动项目的演进与优化。

还没有评论,来说两句吧...