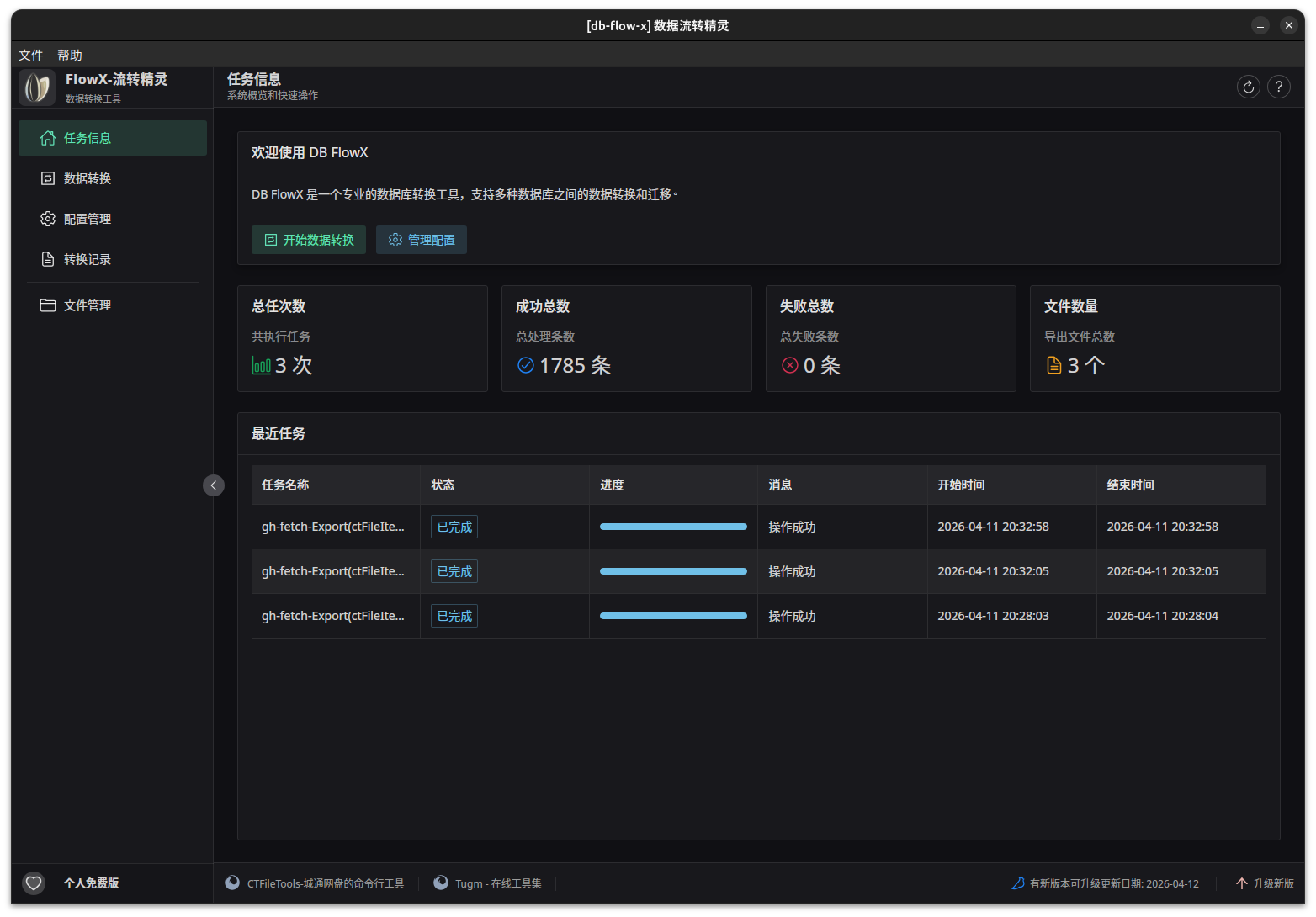

告别数据迁移繁琐!db-flowX 数据流转精灵,小白也能轻松上手的数据库转换神器

做开发、搞运维、处理数据的朋友,一定都遇到过这样的痛点:需要在不同数据库之间迁移数据,要么手动写脚本耗时耗力,要么用复杂工具学习成本高,稍微操作不当就可能出现表结构错乱、数据丢失的问题。尤其是面对多类型数据源切换时,来回折腾半天,效率低到让人崩溃。

今天就给大家安利一款我自主开发的数据库转换工具——db-flowX 数据流转精灵,主打一个简洁高效、上手即用,无需复杂配置,无论是专业开发者还是新手小白,都能轻松搞定各类数据库的表结构和数据迁移需求,彻底告别数据迁移的烦恼~

先给大家划重点:db-flowX 不是那种功能冗余、操作复杂的重型工具,而是聚焦“数据流转”核心需求,做精做细,去掉所有不必要的冗余功能,让每一步操作都直达需求,真正实现“简单操作,高效迁移”。

🌟 核心定位:简洁高效,专注数据流转核心需求

db-flowX(流转精灵)的核心使命,就是解决不同数据库之间、数据文件与数据库之间的迁移难题。在数字化转型加速的当下,数据迁移已从“可选项”变为“必选项”,无论是企业系统升级、数据中心搬迁,还是日常的数据整理备份,都离不开高效的迁移工具。而我们这款工具,就是为了打破传统迁移工具“操作复杂、学习成本高”的壁垒,让每一个需要处理数据流转的人,都能快速上手、高效完成任务。

它不追求功能的“大而全”,但绝对保证核心功能的“精而稳”——无论是表结构的精准映射,还是数据的完整迁移,都能做到高效、无差错,同时兼顾操作的简洁性,让新手也能快速上手,真正实现“零门槛数据迁移”。

📌 核心功能:精准覆盖日常数据迁移全场景

结合日常数据迁移的高频需求,db-flowX 聚焦两大核心功能,同时支持多类型数据源,全方位满足不同场景的使用需求,堪比轻量化的专业数据迁移工具。

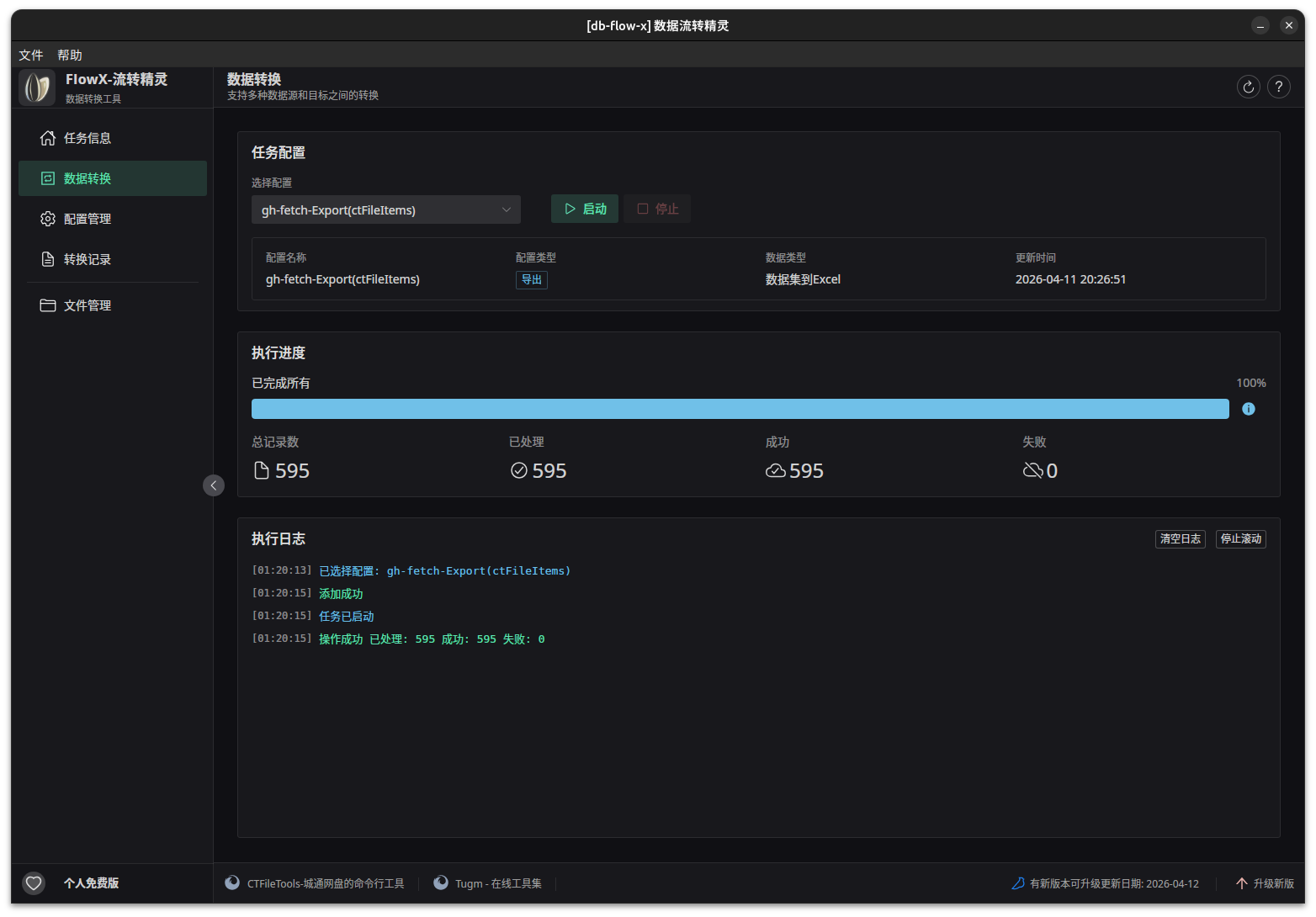

一、快速上手:3步搞定数据迁移,无需复杂配置

很多数据迁移工具的痛点的是“配置繁琐、步骤繁多”,而 db-flowX 简化了所有冗余步骤,只需3步,就能完成从源数据库到目标数据库的完整迁移,全程可视化操作,每一步都清晰易懂:

进入转换页面:点击左侧菜单的“数据转换”,直接进入核心操作界面,无需多余跳转;

配置连接信息:分别选择源数据库和目标数据库的类型(支持MySQL、SQLite、PostgreSQL、SQL Server等),填写对应的连接信息,无需手动编写任何连接脚本,填写完成后自动校验连接可用性;

启动迁移:确认配置无误后,点击“开始转换”,工具将自动完成表结构映射、数据同步,全程无需人工干预,迁移完成后会自动提示结果,清晰告知迁移是否成功、迁移数据量等关键信息。

整个过程最快几分钟就能完成,哪怕是第一次使用,跟着指引操作,也能轻松搞定,彻底告别“写脚本、调配置”的繁琐流程。

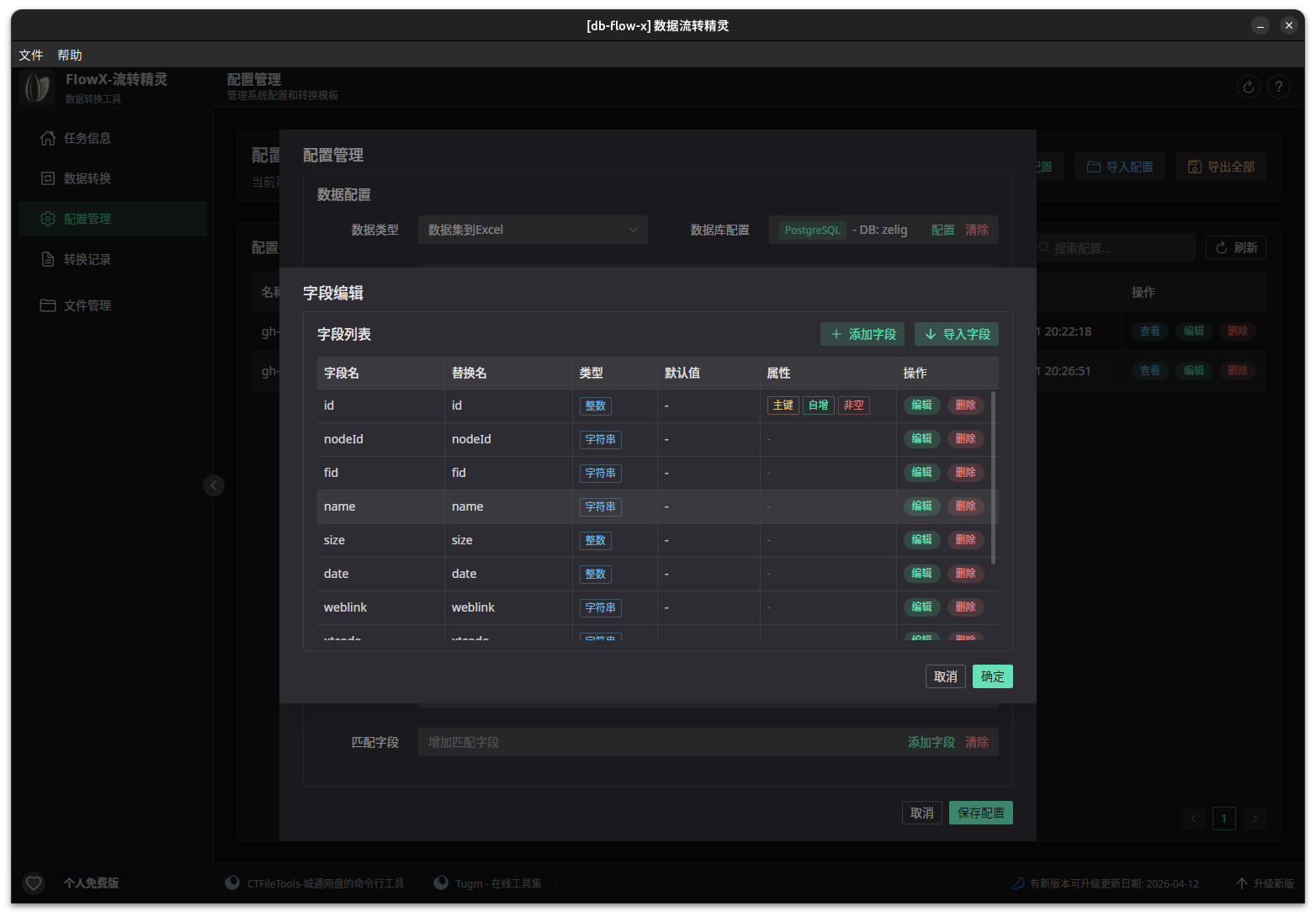

二、配置管理:一键保存,重复使用更高效

如果需要经常在固定的源数据库和目标数据库之间进行迁移,反复配置连接信息会非常耗时。db-flowX 的“配置管理”功能,完美解决了这个问题,让重复迁移更高效:

保存与加载:在“配置管理”页面,可直接保存当前的转换配置,后续需要再次迁移时,直接加载配置即可,无需重新填写连接信息;

导入与导出:支持将配置文件导出保存,也可从本地导入已有的配置文件,方便跨设备使用、团队共享配置,尤其适合多场景、多设备协作的需求;

编辑与删除:可对已保存的配置进行编辑、删除,灵活管理各类迁移配置,避免配置冗余,让管理更有序。

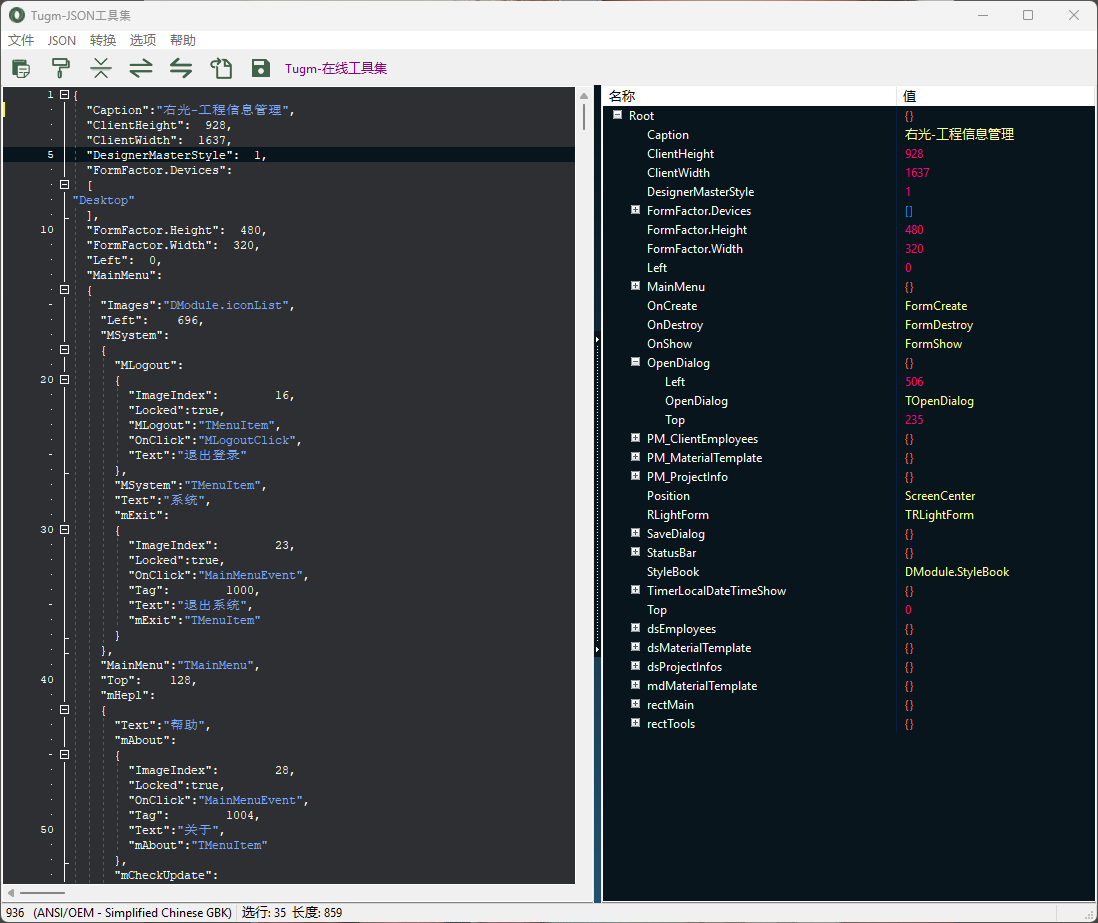

配置也可以手动编辑,然后使用程序配置管理或直接把在主菜单文件选择导入配置粘贴进去,配属格式如下。

{

createTable = false,

dataType = 3,

excludeFields = {id},

inputPath = '',

sheetName = '',

sql = {

charset = '',

database = zelig,

dbType = 4,

host = localhost,

password = xxxxxxxxxxx,

port = 5432,

userName = meow

},

sqlSelect = '',

sqlWhere = '',

tableName = ctFileItems,

target = {

fields = {},

outputPath = /home/icy/Desktop/data.xlsx,

sheetName = ctFileItems,

sql = {

charset = '',

database = '',

dbType = 0,

host = '',

password = '',

port = 0,

userName = ''

},

tableName = '',

where = ''

}

}三、多源支持:覆盖主流数据库与数据文件,告别兼容烦恼

一款好用的数据迁移工具,离不开全面的数据源支持。db-flowX 兼容主流数据库和常用数据文件类型,无需额外安装插件,开箱即用,解决了传统工具“兼容性差”的痛点,真正实现多源数据无缝流转:

支持的数据库类型

MySQL:日常最常用的关系型数据库,完美兼容各类版本;

PostgreSQL:开源高性能数据库,支持复杂查询,迁移无压力;

SQLite:轻量级文件数据库,适合小型项目、本地数据迁移;

SQL Server:微软主流数据库,适配企业级场景的数据迁移需求。

支持的数据文件类型

Excel:日常办公中最常用的数据文件,可直接将Excel中的数据导入数据库,或从数据库导出为Excel;

JSON:主流的数据交换格式,支持JSON文件与数据库之间的双向迁移;

SQL-Insert:支持SQL插入语句文件的导入,可直接将SQL脚本中的数据批量迁移至目标数据库,适配各类脚本迁移场景。

💡 适用人群&场景:谁适合用 db-flowX?

无论是个人开发者、企业运维人员,还是数据处理从业者,只要有数据迁移需求,db-flowX 都能适配,尤其适合这些场景:

个人开发者:项目迭代中,需要在不同数据库之间切换数据,快速完成测试环境与生产环境的数据同步;

企业运维/数据人员:日常数据备份、数据库升级、系统迁移时,需要高效完成大批量数据的迁移,确保数据完整无差错;

办公人员:需要将Excel、JSON中的数据导入数据库进行统一管理,或从数据库导出数据用于报表统计、分析;

新手小白:没有复杂的数据库操作经验,需要一款简单易上手、无需编写脚本的工具,快速完成数据迁移。

✨ 工具亮点:为什么选择 db-flowX?

对比市面上其他数据迁移工具,db-flowX 最大的优势就是“简洁、高效、零门槛”,总结3个核心亮点,看完你就懂为什么值得试:

零学习成本:界面简洁,操作流程清晰,无需专业的数据库知识,无需编写任何脚本,新手也能快速上手;

高效稳定:聚焦核心功能,去掉冗余设计,迁移速度快,同时确保表结构精准映射、数据完整无丢失,避免迁移过程中的各类异常;

多源兼容:覆盖主流数据库和常用数据文件,无需额外安装插件,开箱即用,解决多类型数据源迁移的兼容难题;

灵活便捷:配置可保存、可导入导出,重复迁移更高效,适配个人、团队等多种使用场景,兼顾实用性与便捷性。

📝 最后想说

开发 db-flowX 的初衷,就是因为自己在日常开发和工作中,经常被数据迁移的繁琐流程困扰——要么工具太复杂,学习半天不会用;要么功能太简单,满足不了多场景需求。所以就想着做一款“够用、好用、易用”的轻量化数据迁移工具,解决自己的痛点,也希望能帮到有同样需求的朋友。

目前 db-flowX 已实现核心的数据库转换与数据迁移功能,后续也会根据大家的使用反馈,持续优化体验、增加更多实用功能(比如数据清洗、增量迁移等),让数据流转变得更简单。

如果你也经常需要处理数据迁移,被繁琐的操作困扰,不妨试试 db-flowX 数据流转精灵,相信它能帮你节省大量时间和精力,让数据迁移变得轻松高效~

后续会持续更新工具的使用技巧、常见问题解答,大家有任何使用需求、建议,都可以在评论区留言,一起完善这款工具,让它更好地服务于每一个需要数据流转的人!

由于我平时工作等基本使用Ubuntu系统,程序在windows下测试有限,如有问题可提出.

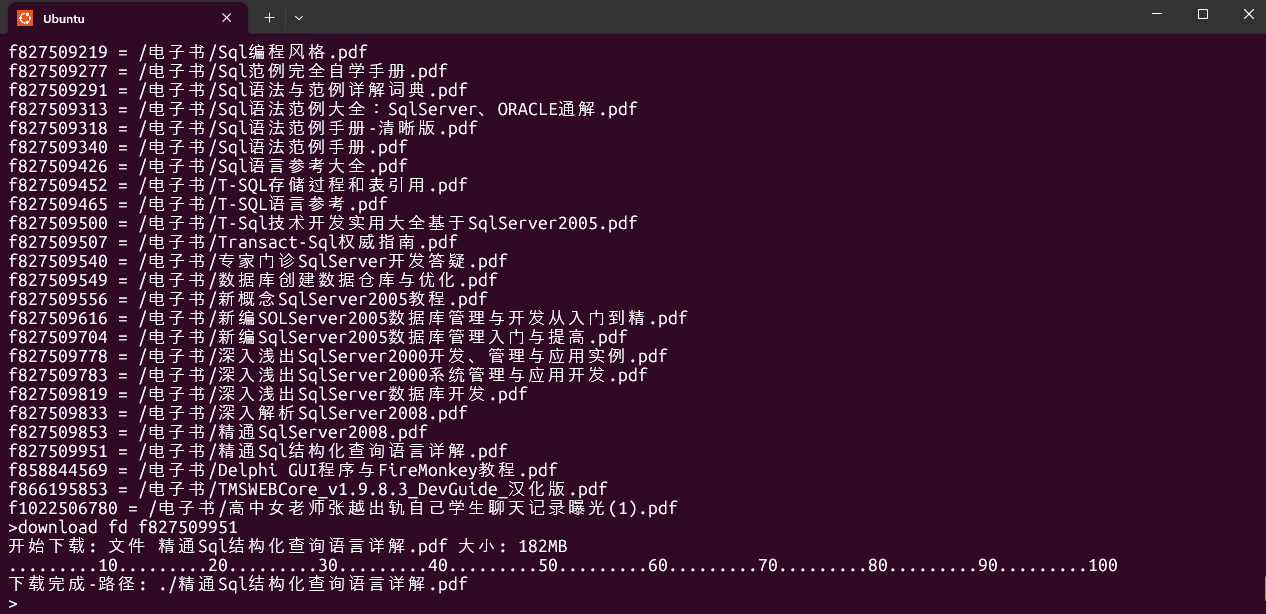

Debian/Linux 下可以直接使用以下命令

curl -fsSL https://sh.toolsify.cn/setup/db-flowX-debian.sh | bash

还没有评论,来说两句吧...