Ceph 是一个统一的分布式存储系统,设计初衷是提供优秀的性能、可靠性和可扩展性。作为一个开源项目,它已经成为 OpenStack 的事实标准存储后端,并被广泛应用于私有云和公有云环境。本项目完全采用 C++ 编写,充分利用了现代 C++ 的特性来实现高性能的网络通信和数据管理。理解 Ceph 的架构与代码实现,对于从事存储开发、运维以及云计算领域的工程师而言,具有极高的价值。

核心架构解析

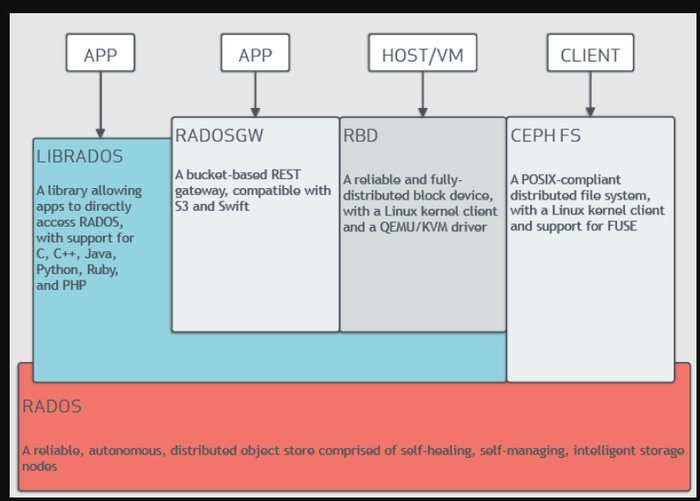

Ceph 的核心是 RADOS(Reliable Autonomic Distributed Object Store)。所有的上层接口,如块设备、对象存储和文件系统,都构建在 RADOS 之上。RADOS 集群由多个 OSD(Object Storage Daemon)组成。每个 OSD 负责管理物理磁盘上的数据,处理数据复制、恢复、回填和重新平衡等任务。

Ceph 客户端通过 CRUSH 算法直接计算数据位置,无需元数据服务器介入,从而消除了性能瓶颈。CRUSH 算法允许客户端根据集群映射图计算出数据对象应该存储在哪个 OSD 上,这种去中心化的设计是 Ceph 能够扩展到 EB 级别的关键。

接口层分类

- RBD (RADOS Block Device): 提供块存储接口,常用于虚拟机磁盘。它支持快照、克隆和增量备份等功能。

- RGW (RADOS Gateway): 提供兼容 Amazon S3 和 OpenStack Swift 的对象存储接口,适合存储非结构化数据。

- CephFS: 提供 POSIX 兼容的文件系统接口,通过 MDS(Metadata Server)管理文件元数据。

C++ 代码结构概览

在 GitHub 仓库中,源代码主要分布在 src 目录下。关键组件包括:

src/osd: OSD 守护进程的核心逻辑,处理数据读写请求。src/mon: Monitor 守护进程,维护集群状态映射,确保集群一致性。src/client: CephFS 客户端实现,处理文件系统请求。src/librados: 提供给开发者使用的 C++ 和 C 接口库,是应用集成的基础。

Ceph 大量使用了 C++11 及更高版本的标准,包括智能指针、lambda 表达式以及异步编程模型。例如,在 src/include/encoding.h 中定义了高效的序列化机制,用于网络传输中的数据编码。内存管理方面,Ceph 实现了自定义的内存池以减少碎片化,提升高并发下的性能表现。

BlueStore 是 Ceph 默认的存储引擎,它直接管理裸设备,绕过了传统文件系统层。BlueStore 的 C++ 实现涉及复杂的 RocksDB 集成,用于存储元数据和 WAL 日志。开发者在阅读 src/os/bluestore 目录代码时,可以深入了解现代存储引擎的设计思路。

实战示例:使用 librados 进行开发

虽然 Ceph 提供了命令行工具,但开发者通常需要通过 librados 库将存储功能集成到自己的应用中。以下是一个简单的 C++ 示例,展示如何连接到 Ceph 集群并写入对象。

#include <iostream>

#include <rados/librados.hpp>

#include <string>

using namespace librados;

int main() {

Rados rados;

IoCtx io_ctx;

std::string pool_name = "data";

std::string object_name = "test_object";

std::string data = "Hello Ceph!";

// 初始化集群连接

int ret = rados.init("admin");

if (ret < 0) {

std::cerr << "Failed to initialize rados" << std::endl;

return ret;

}

// 读取配置文件

ret = rados.conf_read_file("/etc/ceph/ceph.conf");

if (ret < 0) {

std::cerr << "Failed to read config file" << std::endl;

return ret;

}

// 连接到集群

ret = rados.connect();

if (ret < 0) {

std::cerr << "Failed to connect to cluster" << std::endl;

return ret;

}

// 创建 IO 上下文

ret = rados.ioctx_create(pool_name.c_str(), io_ctx);

if (ret < 0) {

std::cerr << "Failed to create io context" << std::endl;

return ret;

}

// 写入对象

ret = io_ctx.write(object_name.c_str(), data.c_str(), data.length(), 0);

if (ret < 0) {

std::cerr << "Failed to write object" << std::endl;

return ret;

}

std::cout << "Successfully wrote to Ceph cluster" << std::endl;

// 清理资源

io_ctx.close();

rados.shutdown();

return 0;

}

编译上述代码需要链接 rados 库:

g++ -o ceph_example ceph_example.cpp -lrados

运行程序前,确保当前用户具有访问 Ceph 集群的权限,并且 ceph.conf 配置文件路径正确。该示例展示了最基本的对象写入流程,实际生产中还需处理异步回调、错误重试以及连接池管理等复杂逻辑。

命令行操作实例

对于运维人员,熟练使用 ceph 和 rados 命令行工具至关重要。以下是常用操作示例。

查看集群状态

ceph -s

该命令会输出集群的健康状态、Monitor 状态、OSD 状态以及存储池的使用情况。健康状态应显示为 HEALTH_OK。

创建存储池

ceph osd pool create mypool 32 32

创建一个名为 mypool 的存储池,PG 数量为 32。PG 数量的设置需要根据 OSD 总数进行估算,以保证数据分布均匀。

上传对象

rados put -p mypool test_object /path/to/local/file

将本地文件上传到指定存储池中。

查看对象映射

ceph osd map mypool test_object

此命令显示对象存储在哪个 OSD 上,体现了 CRUSH 算法的分布结果。通过该信息可以排查数据倾斜问题。

开发与贡献指南

Ceph 社区非常活跃,欢迎开发者贡献代码。由于项目庞大,初学者建议从修复简单的 Bug 或完善文档开始。

- 环境搭建: 推荐使用

vstart.sh脚本在本地快速启动一个开发集群,无需完整的安装过程。该脚本会编译源码并启动必要的守护进程。 - 编码规范: 项目遵循严格的 C++ 编码规范,提交前需通过

make check测试。代码风格需符合 Clang-Format 配置。 - 提交流程: 代码提交通过 GitHub Pull Request 进行,需要经过 CI 测试和社区审查。审查过程可能涉及多轮修改。

在 src 目录下,可以看到大量的单元测试位于 unittest 文件夹中。编写测试用例是确保代码质量的关键环节。Ceph 使用了 Google Test 框架进行测试。开发者在添加新功能时,必须同步编写相应的测试用例,以防止回归错误。

性能优化要点

在生产环境中,Ceph 的性能调优涉及多个层面。

- 网络: 建议使用万兆网络,并启用 Jumbo Frames。分离公共网络和集群网络可以减少流量干扰。

- 磁盘: SSD 作为 WAL 和 DB 分区可以显著提升 OSD 性能。BlueStore 引擎对 SSD 利用率高,建议混合部署。

- 参数调优: 修改

ceph.conf中的参数,如osd_op_threads和filestore_queue_max_bytes,可以根据硬件配置优化吞吐量。

C++ 层面的优化主要包括减少内存拷贝、优化锁粒度以及使用更高效的数据结构。例如,在较新的版本中,通过引入 Coroutines 优化了异步 IO 处理流程。开发者可以通过 perf 工具分析热点函数,针对性地进行优化。

总结

Ceph 项目展示了 C++ 在系统级编程中的强大能力。通过分布式架构设计,它实现了存储的高可用性和无限扩展性。无论是作为使用者还是开发者,深入理解 Ceph 的内部机制都能带来巨大的价值。对于希望涉足分布式存储领域的工程师而言,阅读 Ceph 源码是极佳的学习途径。

随着云原生技术的发展,Ceph 也在不断演进,支持 Kubernetes CSI 插件等新特性。保持对项目的关注,积极参与社区互动,将有助于掌握存储技术的前沿动态。通过实践上述示例和指南,开发者可以快速上手 Ceph 开发与运维工作。

还没有评论,来说两句吧...